Featureselectie via feature-importance

In de vorige oefening heb je geoefend met hoe filter- en wrappermethoden handig kunnen zijn bij het selecteren van features in Machine Learning en in Machine Learning-sollicitaties. In deze oefening ga je aan de slag met featureselectiemethoden door de ingebouwde feature-importance te gebruiken in boomgebaseerde Machine Learning-algoritmen op de diabetes-DataFrame.

Hoewel je op DataCamp maar met een paar ervan kunt oefenen, is er uitstekende documentatie op de scikit-learn-website waarin verschillende andere manieren om features te selecteren worden besproken.

De featurematrix en de doelfunctie-array zijn opgeslagen in je werkruimte als respectievelijk X en y.

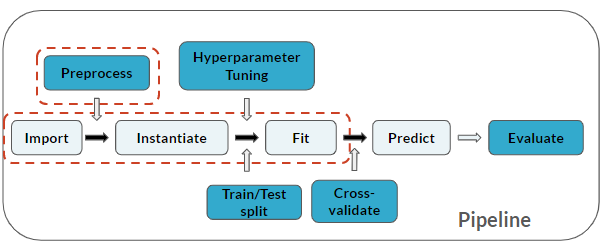

Onthoud dat featureselectie wordt gezien als een preprocessing-stap:

Deze oefening maakt deel uit van de cursus

Machine Learning-sollicitatievragen oefenen in Python

Praktische interactieve oefening

Probeer deze oefening eens door deze voorbeeldcode in te vullen.

# Import

from sklearn.ensemble import ____

# Instantiate

rf_mod = ____(max_depth=2, random_state=123,

n_estimators=100, oob_score=True)

# Fit

rf_mod.____(____, ____)

# Print

print(diabetes.columns)

print(rf_mod.____)