Actor-Critic: verliesberekeningen

Als laatste stap voordat je je agent met A2C kunt trainen, schrijf je een functie calculate_losses() die de verliezen voor beide netwerken teruggeeft.

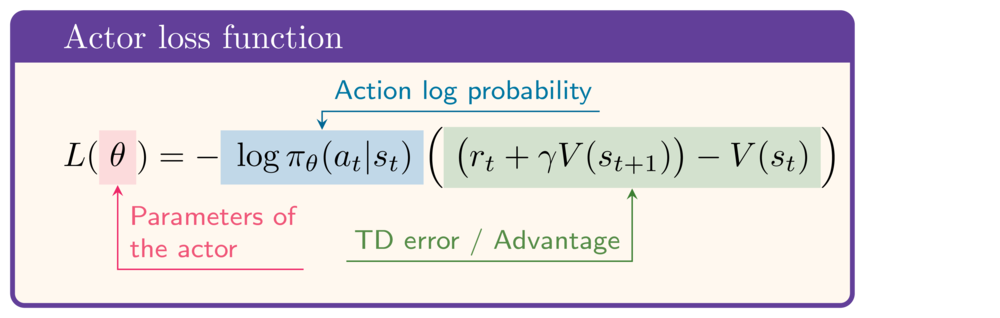

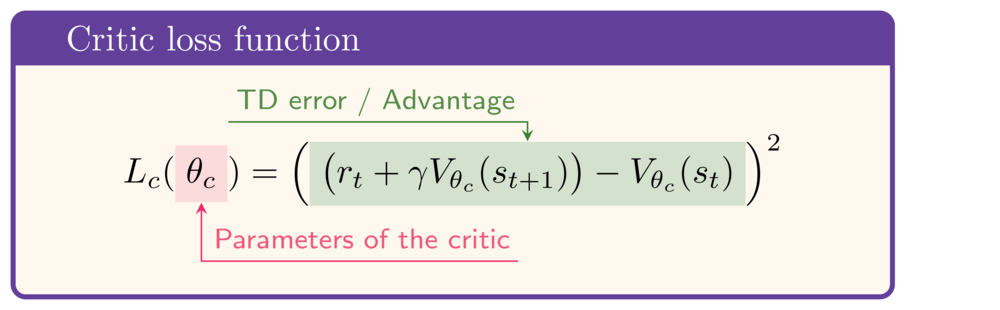

Ter referentie: dit zijn respectievelijk de uitdrukkingen voor de verliesfuncties van de actor en de critic:

Deze oefening maakt deel uit van de cursus

Deep Reinforcement Learning in Python

Oefeninstructies

- Bereken de TD-doelwaarde.

- Bereken het verlies voor het Actor-netwerk.

- Bereken het verlies voor het Critic-netwerk.

Praktische interactieve oefening

Probeer deze oefening eens door deze voorbeeldcode in te vullen.

def calculate_losses(critic_network, action_log_prob,

reward, state, next_state, done):

value = critic_network(state)

next_value = critic_network(next_state)

# Calculate the TD target

td_target = (____ + gamma * ____ * (1-done))

td_error = td_target - value

# Calculate the actor loss

actor_loss = -____ * ____.detach()

# Calculate the critic loss

critic_loss = ____

return actor_loss, critic_loss

actor_loss, critic_loss = calculate_losses(

critic_network, action_log_prob,

reward, state, next_state, done

)

print(round(actor_loss.item(), 2), round(critic_loss.item(), 2))