Yerel minimadan kaçınma

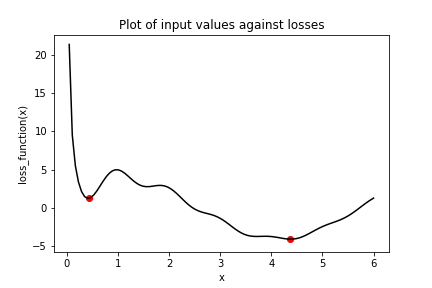

Önceki soruda yerel minimaya takılmanın ne kadar kolay olduğunu gördün. Tek değişkenli basit bir optimizasyon problemimiz vardı ve önce yerel minimadan geçmemiz gerektiğinde, gradyan inişi yine de küresel minimumu bulmayı başaramadı. Bu sorunu aşmanın bir yolu, optimize edicinin yerel minimayı aşmasını sağlayan momentum kullanmaktır. Yine önceki sorudaki ve senin için loss_function() olarak tanımlanıp hazır bulunan kayıp fonksiyonunu kullanacağız.

tensorflow içindeki birkaç optimize edicide, SGD ve RMSprop dahil, momentum parametresi bulunur. Bu egzersizde RMSprop kullanacaksın. Dikkat et, bu kez x_1 ve x_2 aynı değere başlatıldı. Ayrıca keras.optimizers.RMSprop() da senin için tensorflowdan içe aktarıldı.

Bu egzersiz

Python ile TensorFlow’a Giriş

kursunun bir parçasıdırEgzersiz talimatları

opt_1işlemini öğrenme oranı 0.01 ve momentum 0.99 kullanacak şekilde ayarla.opt_2yi, öğrenme oranı 0.01 ve momentum 0.00 olan RMS (root mean square propagation) optimize edicisini kullanacak şekilde ayarla.opt_2için minimizasyon işlemini tanımla.x_1vex_2yinumpydizileri olarak yazdır.

Uygulamalı interaktif egzersiz

Bu örnek kodu tamamlayarak bu egzersizi bitirin.

# Initialize x_1 and x_2

x_1 = Variable(0.05,float32)

x_2 = Variable(0.05,float32)

# Define the optimization operation for opt_1 and opt_2

opt_1 = keras.optimizers.RMSprop(learning_rate=____, momentum=____)

opt_2 = ____

for j in range(100):

opt_1.minimize(lambda: loss_function(x_1), var_list=[x_1])

# Define the minimization operation for opt_2

____

# Print x_1 and x_2 as numpy arrays

print(____, ____)