Utiliser l’opération de couche dense

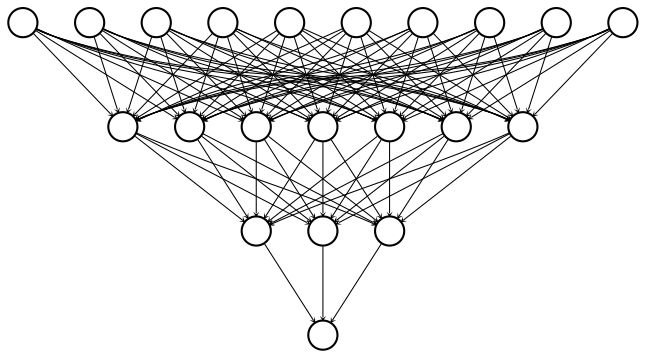

Nous avons vu comment définir des couches denses dans tensorflow à l’aide de l’algèbre linéaire. Dans cet exercice, nous allons ignorer l’algèbre linéaire et laisser keras gérer les détails. Cela nous permettra de construire le réseau ci-dessous, qui comporte 2 couches cachées et 10 variables, avec moins de code que pour le réseau à 1 couche cachée et 3 variables.

Pour construire ce réseau, nous devons définir trois couches denses, chacune prenant la couche précédente en entrée, la multipliant par des poids et appliquant une fonction d’activation. Notez que les données d’entrée ont été définies et sont disponibles sous forme de tenseur 100x10 : borrower_features. De plus, le module keras.layers est disponible.

Cet exercice fait partie du cours

Introduction à TensorFlow en Python

Instructions

- Définissez

dense1comme une couche dense avec 7 nœuds de sortie et une fonction d’activation sigmoïde. - Définissez

dense2comme une couche dense avec 3 nœuds de sortie et une fonction d’activation sigmoïde. - Définissez

predictionscomme une couche dense avec 1 nœud de sortie et une fonction d’activation sigmoïde. - Affichez les formes de

dense1,dense2etpredictions, dans cet ordre, en utilisant la méthode.shape. Pourquoi chacun de ces tenseurs a-t-il 100 lignes ?

Exercice interactif pratique

Essayez cet exercice en complétant cet exemple de code.

# Define the first dense layer

dense1 = keras.layers.Dense(____, activation='____')(borrower_features)

# Define a dense layer with 3 output nodes

dense2 = ____

# Define a dense layer with 1 output node

predictions = ____

# Print the shapes of dense1, dense2, and predictions

print('\n shape of dense1: ', dense1.shape)

print('\n shape of dense2: ', ____.shape)

print('\n shape of predictions: ', ____.shape)