Actor-Critic kayıp hesaplamaları

A2C ile ajanını eğitmeden önce son adım olarak, her iki ağ için kayıpları döndüren bir calculate_losses() fonksiyonu yaz.

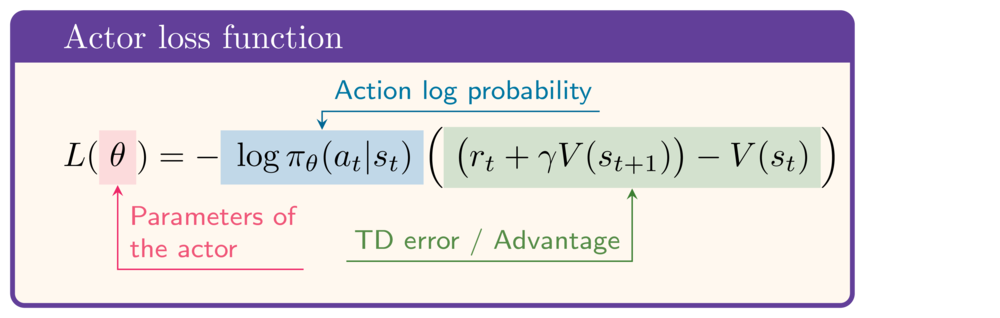

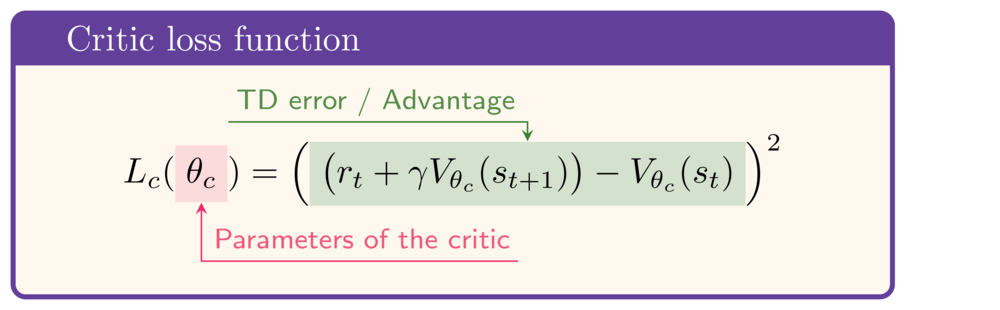

Referans olması için, aktör ve eleştirmen kayıp fonksiyonlarının ifadeleri sırasıyla şunlardır:

Bu egzersiz

Python ile Deep Reinforcement Learning

kursunun bir parçasıdırEgzersiz talimatları

- TD hedefini hesapla.

- Aktör ağı için kaybı hesapla.

- Eleştirmen ağı için kaybı hesapla.

Uygulamalı interaktif egzersiz

Bu örnek kodu tamamlayarak bu egzersizi bitirin.

def calculate_losses(critic_network, action_log_prob,

reward, state, next_state, done):

value = critic_network(state)

next_value = critic_network(next_state)

# Calculate the TD target

td_target = (____ + gamma * ____ * (1-done))

td_error = td_target - value

# Calculate the actor loss

actor_loss = -____ * ____.detach()

# Calculate the critic loss

critic_loss = ____

return actor_loss, critic_loss

actor_loss, critic_loss = calculate_losses(

critic_network, action_log_prob,

reward, state, next_state, done

)

print(round(actor_loss.item(), 2), round(critic_loss.item(), 2))