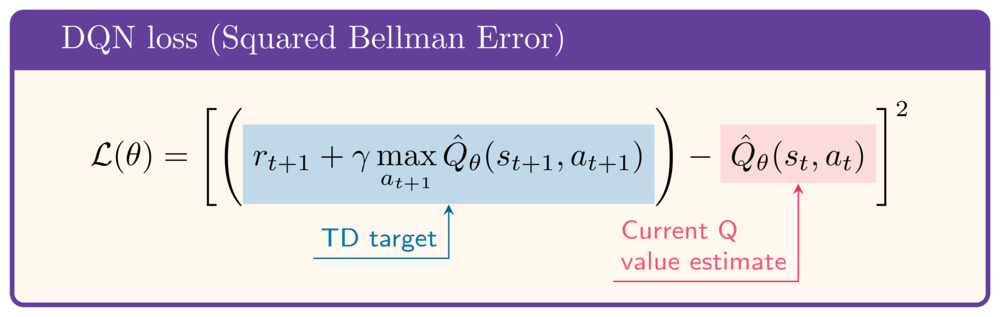

Temel DQN kayıp fonksiyonu

select_action() işlevi artık hazır olduğuna göre, ajanını eğitebilmek için son bir adımdasın: şimdi calculate_loss()'u uygulayacaksın.

calculate_loss() bir bölümün herhangi bir adımı için ağın kaybını döndürür.

Referans olarak, kayıp şu şekilde verilir:

Aşağıdaki örnek veriler egzersize yüklendi:

state = torch.rand(8)

next_state = torch.rand(8)

action = select_action(q_network, state)

reward = 1

gamma = .99

done = False

Bu egzersiz

Python ile Deep Reinforcement Learning

kursunun bir parçasıdırEgzersiz talimatları

- Mevcut durumun Q-değerini elde et.

- Sonraki durumun Q-değerini elde et.

- Hedef Q-değerini (TD-target) hesapla.

- Kayıp fonksiyonunu, yani karesel Bellman Hatasını hesapla.

Uygulamalı interaktif egzersiz

Bu örnek kodu tamamlayarak bu egzersizi bitirin.

def calculate_loss(q_network, state, action, next_state, reward, done):

q_values = q_network(state)

print(f'Q-values: {q_values}')

# Obtain the current state Q-value

current_state_q_value = q_values[____]

print(f'Current state Q-value: {current_state_q_value:.2f}')

# Obtain the next state Q-value

next_state_q_value = q_network(next_state).____

print(f'Next state Q-value: {next_state_q_value:.2f}')

# Calculate the target Q-value

target_q_value = ____ + gamma * ____ * (1-done)

print(f'Target Q-value: {target_q_value:.2f}')

# Obtain the loss

loss = nn.MSELoss()(____, ____)

print(f'Loss: {loss:.2f}')

return loss

calculate_loss(q_network, state, action, next_state, reward, done)