Audioreiniging (denoising)

In deze oefening ga je data gebruiken uit de WHAM-gegevensset, waarin spraak wordt gemixt met achtergrondgeluid, om nieuwe spraak te genereren in een andere stem én zonder het achtergrondgeluid!

De array example_speech en de vector speaker_embedding van de nieuwe stem zijn al geladen. De preprocessor (processor) en vocoder (vocoder) zijn ook beschikbaar, samen met de module SpeechT5ForSpeechToSpeech. Er is een functie make_spectrogram() meegeleverd om te helpen bij het plotten.

Deze oefening maakt deel uit van de cursus

Multi-modale modellen met Hugging Face

Oefeninstructies

- Laad het voorgetrainde model

SpeechT5ForSpeechToSpeechmet hetmicrosoft/speecht5_vc-checkpoint. - Verwerk

example_speechvoor met een samplingfrequentie van16000. - Genereer de opgeschoonde spraak met

.generate_speech().

Praktische interactieve oefening

Probeer deze oefening eens door deze voorbeeldcode in te vullen.

# Load the SpeechT5ForSpeechToSpeech pretrained model

model = ____

# Preprocess the example speech

inputs = ____(audio=____, sampling_rate=____, return_tensors="pt")

# Generate the denoised speech

speech = ____

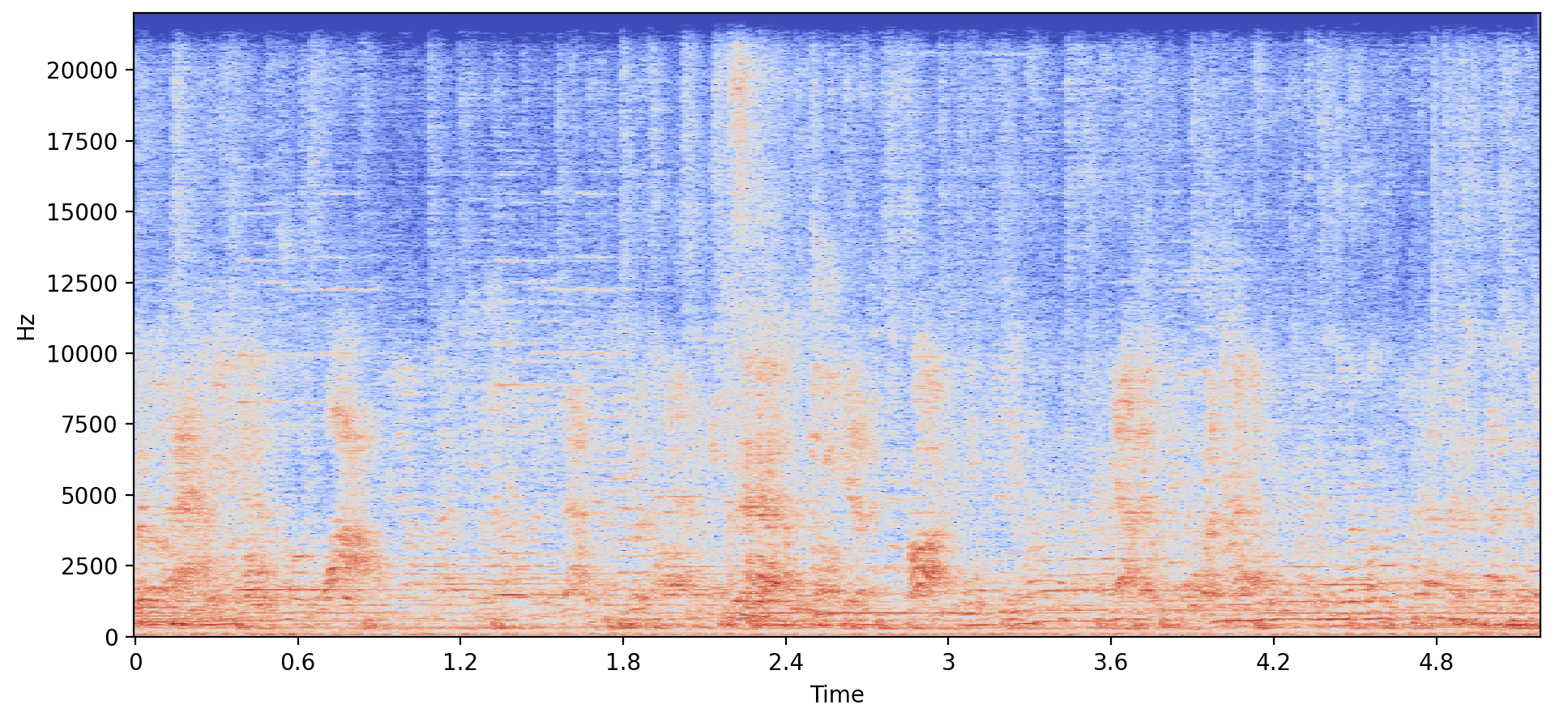

make_spectrogram(speech)

sf.write("speech.wav", speech.numpy(), samplerate=16000)