Afbeeldingen preprocessen

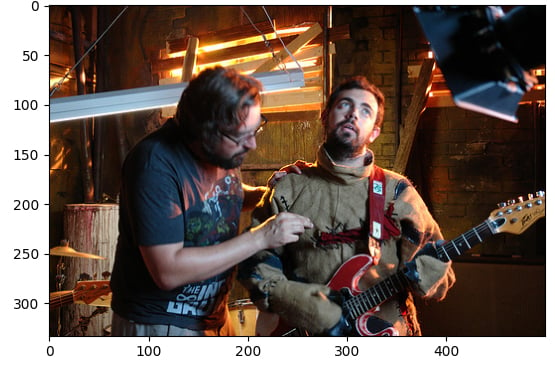

In deze oefening ga je de flickr-gegevensset gebruiken, met 30.000 afbeeldingen en bijbehorende bijschriften, om bewerkingen voor preprocessing op afbeeldingen uit te voeren. Deze preprocessing is nodig om de afbeeldingsgegevens geschikt te maken voor inferencing met Hugging Face-modeltaken, zoals tekstgeneratie uit afbeeldingen. In dit geval genereer je een tekstcaption voor deze afbeelding:

De gegevensset (dataset) is geladen met de volgende structuur:

Dataset({

features: ['image', 'caption', 'sentids', 'split', 'img_id', 'filename'],

num_rows: 10

})

Het model voor image captioning (model) is geladen.

Deze oefening maakt deel uit van de cursus

Multi-modale modellen met Hugging Face

Oefeninstructies

- Laad de afbeelding van het element op index

5van de gegevensset. - Laad de image processor (

BlipProcessor) van het pretrained model:Salesforce/blip-image-captioning-base. - Voer de processor uit op

imageen geef aan dat PyTorch-tensors (pt) vereist zijn. - Gebruik de methode

.generate()om met hetmodeleen caption te genereren.

Praktische interactieve oefening

Probeer deze oefening eens door deze voorbeeldcode in te vullen.

# Load the image from index 5 of the dataset

image = dataset[5]["____"]

# Load the image processor of the pretrained model

processor = ____.____("Salesforce/blip-image-captioning-base")

# Preprocess the image

inputs = ____(images=____, return_tensors="pt")

# Generate a caption using the model

output = ____(**inputs)

print(f'Generated caption: {processor.decode(output[0])}')

print(f'Original caption: {dataset[5]["caption"][0]}')