Calcolo delle loss di Actor-Critic

Come ultimo passo prima di addestrare il tuo agente con A2C, scrivi una funzione calculate_losses() che restituisca le loss per entrambe le reti.

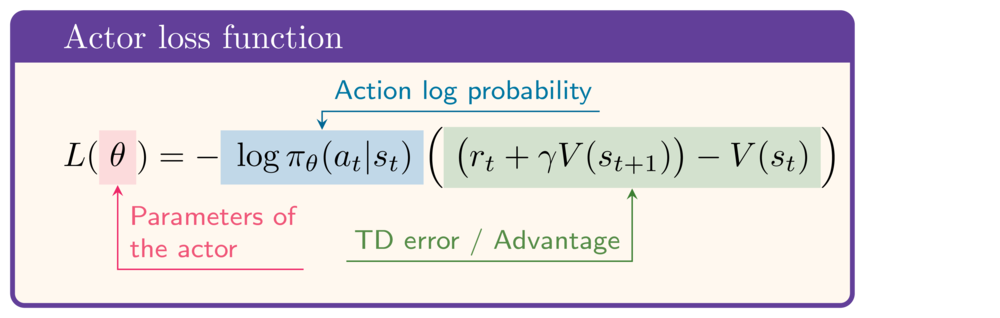

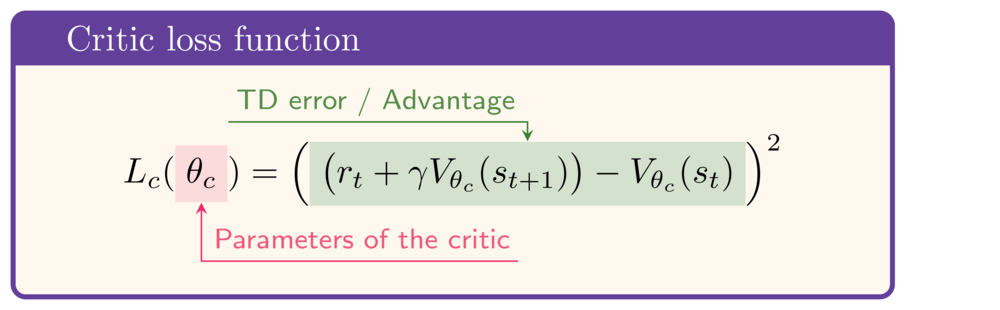

Per riferimento, queste sono le espressioni rispettivamente per le funzioni di loss di actor e critic:

Questo esercizio fa parte del corso

Deep Reinforcement Learning in Python

Istruzioni dell'esercizio

- Calcola il target TD.

- Calcola la loss per la rete Actor.

- Calcola la loss per la rete Critic.

Esercizio pratico interattivo

Prova a risolvere questo esercizio completando il codice di esempio.

def calculate_losses(critic_network, action_log_prob,

reward, state, next_state, done):

value = critic_network(state)

next_value = critic_network(next_state)

# Calculate the TD target

td_target = (____ + gamma * ____ * (1-done))

td_error = td_target - value

# Calculate the actor loss

actor_loss = -____ * ____.detach()

# Calculate the critic loss

critic_loss = ____

return actor_loss, critic_loss

actor_loss, critic_loss = calculate_losses(

critic_network, action_log_prob,

reward, state, next_state, done

)

print(round(actor_loss.item(), 2), round(critic_loss.item(), 2))