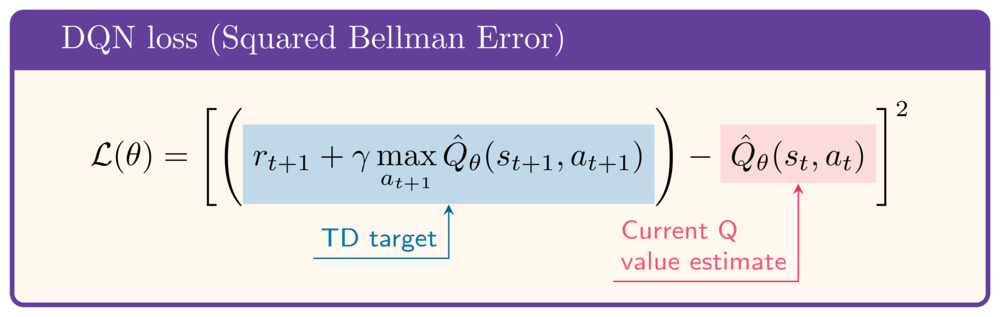

Funzione di loss del DQN essenziale

Ora che la funzione select_action() è pronta, ti manca solo un ultimo passo per poter addestrare il tuo agente: implementerai calculate_loss().

calculate_loss() restituisce la loss della rete per un dato passo dell'episodio.

Per riferimento, la loss è definita come segue:

Nel seguente esempio, i dati sono già stati caricati nell'esercizio:

state = torch.rand(8)

next_state = torch.rand(8)

action = select_action(q_network, state)

reward = 1

gamma = .99

done = False

Questo esercizio fa parte del corso

Deep Reinforcement Learning in Python

Istruzioni dell'esercizio

- Ottieni il Q-value dello stato corrente.

- Ottieni il Q-value del prossimo stato.

- Calcola il Q-value target, o TD-target.

- Calcola la funzione di loss, cioè il Bellman Error al quadrato.

Esercizio pratico interattivo

Prova a risolvere questo esercizio completando il codice di esempio.

def calculate_loss(q_network, state, action, next_state, reward, done):

q_values = q_network(state)

print(f'Q-values: {q_values}')

# Obtain the current state Q-value

current_state_q_value = q_values[____]

print(f'Current state Q-value: {current_state_q_value:.2f}')

# Obtain the next state Q-value

next_state_q_value = q_network(next_state).____

print(f'Next state Q-value: {next_state_q_value:.2f}')

# Calculate the target Q-value

target_q_value = ____ + gamma * ____ * (1-done)

print(f'Target Q-value: {target_q_value:.2f}')

# Obtain the loss

loss = nn.MSELoss()(____, ____)

print(f'Loss: {loss:.2f}')

return loss

calculate_loss(q_network, state, action, next_state, reward, done)