Perhitungan rugi Actor-Critic

Sebagai langkah terakhir sebelum Anda dapat melatih agen dengan A2C, tulislah fungsi calculate_losses() yang mengembalikan nilai rugi untuk kedua jaringan.

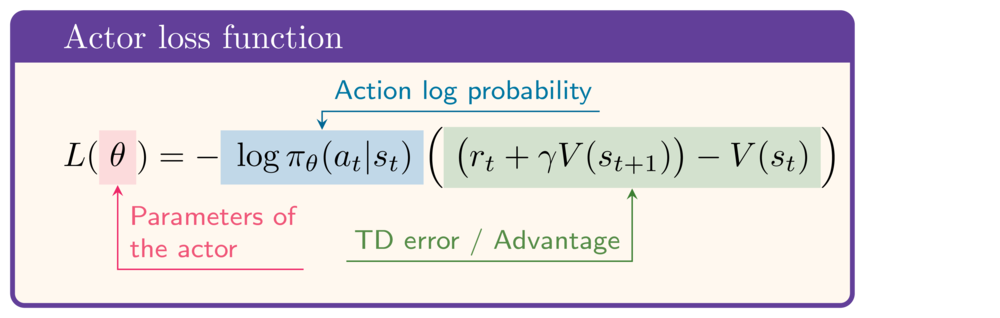

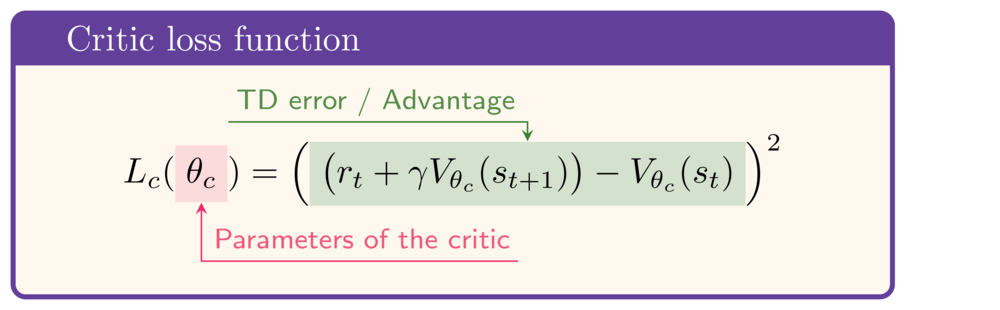

Sebagai referensi, berikut adalah ekspresi untuk fungsi rugi aktor dan kritikus masing-masing:

Latihan ini adalah bagian dari kursus

Deep Reinforcement Learning dengan Python

Petunjuk latihan

- Hitung target TD.

- Hitung rugi untuk jaringan Actor.

- Hitung rugi untuk jaringan Critic.

Latihan interaktif praktis

Cobalah latihan ini dengan menyelesaikan kode contoh berikut.

def calculate_losses(critic_network, action_log_prob,

reward, state, next_state, done):

value = critic_network(state)

next_value = critic_network(next_state)

# Calculate the TD target

td_target = (____ + gamma * ____ * (1-done))

td_error = td_target - value

# Calculate the actor loss

actor_loss = -____ * ____.detach()

# Calculate the critic loss

critic_loss = ____

return actor_loss, critic_loss

actor_loss, critic_loss = calculate_losses(

critic_network, action_log_prob,

reward, state, next_state, done

)

print(round(actor_loss.item(), 2), round(critic_loss.item(), 2))