Fungsi loss DQN sederhana

Dengan fungsi select_action() yang kini siap, Anda tinggal satu langkah terakhir sebelum dapat melatih agen Anda: sekarang Anda akan mengimplementasikan calculate_loss().

calculate_loss() mengembalikan loss jaringan untuk setiap langkah dalam suatu episode.

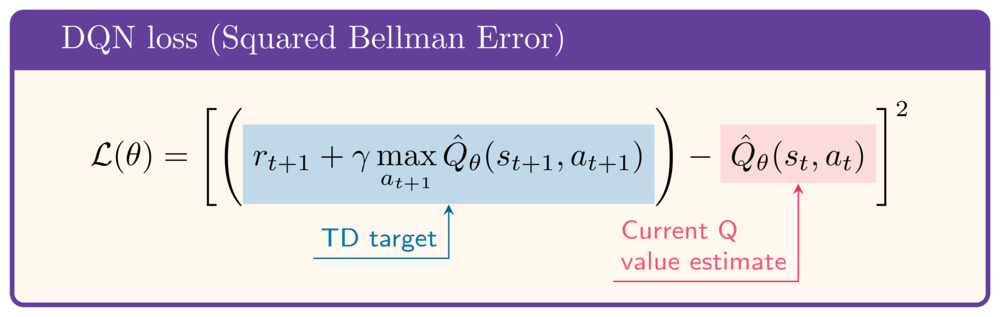

Sebagai referensi, rumus loss adalah sebagai berikut:

Data contoh berikut telah dimuat dalam latihan:

state = torch.rand(8)

next_state = torch.rand(8)

action = select_action(q_network, state)

reward = 1

gamma = .99

done = False

Latihan ini adalah bagian dari kursus

Deep Reinforcement Learning dengan Python

Petunjuk latihan

- Peroleh nilai Q untuk state saat ini.

- Peroleh nilai Q untuk state berikutnya.

- Hitung nilai Q target, atau TD-target.

- Hitung fungsi loss, yaitu squared Bellman Error.

Latihan interaktif praktis

Cobalah latihan ini dengan menyelesaikan kode contoh berikut.

def calculate_loss(q_network, state, action, next_state, reward, done):

q_values = q_network(state)

print(f'Q-values: {q_values}')

# Obtain the current state Q-value

current_state_q_value = q_values[____]

print(f'Current state Q-value: {current_state_q_value:.2f}')

# Obtain the next state Q-value

next_state_q_value = q_network(next_state).____

print(f'Next state Q-value: {next_state_q_value:.2f}')

# Calculate the target Q-value

target_q_value = ____ + gamma * ____ * (1-done)

print(f'Target Q-value: {target_q_value:.2f}')

# Obtain the loss

loss = nn.MSELoss()(____, ____)

print(f'Loss: {loss:.2f}')

return loss

calculate_loss(q_network, state, action, next_state, reward, done)