Q-Werte berechnen

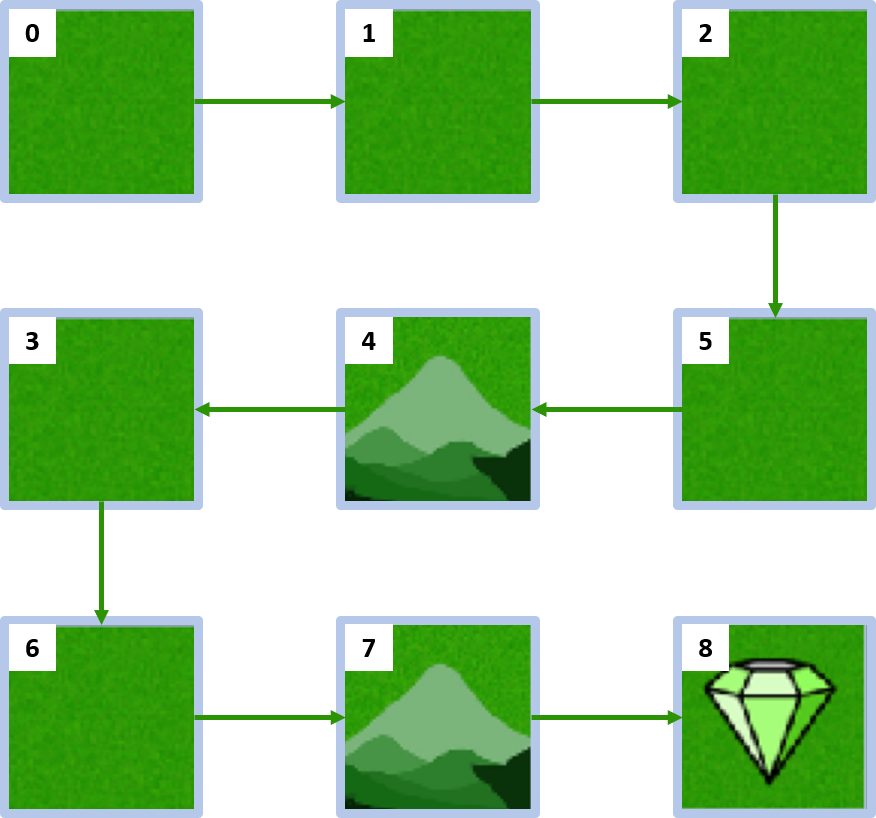

Dein Ziel ist es, die Aktionswerte – auch Q-Werte genannt – für jedes Zustands-Aktions-Paar in der benutzerdefinierten Umgebung MyGridWorld zu berechnen, wenn du die unten gezeigte Policy befolgst. In RL sind Q-Werte zentral, weil sie den erwarteten Nutzen darstellen, wenn in einem gegebenen Zustand eine bestimmte Aktion ausgeführt wird und anschließend der Policy gefolgt wird.

Die Umgebung wurde als env importiert, zusammen mit der Funktion compute_state_value() sowie den benötigten Variablen (terminal_state, num_states, num_actions, policy, gamma).

Diese Übung ist Teil des Kurses

Reinforcement Learning mit Gymnasium in Python

Anleitung zur Übung

- Vervollständige die Funktion

compute_q_value(), um den Aktionswert für einen gegebenenstateund eineactionzu berechnen. - Erstelle ein Dictionary

Q, in dem jeder Schlüssel ein Zustands-Aktions-Paar darstellt und der zugehörige Wert der Q-Wert für dieses Paar ist.

Interaktive Übung

Vervollständige den Beispielcode, um diese Übung erfolgreich abzuschließen.

# Complete the function to compute the action-value for a state-action pair

def compute_q_value(state, action):

if state == terminal_state:

return None

probability, next_state, reward, done = ____

return ____

# Compute Q-values for each state-action pair

Q = {(____, ____): _____ for ____ in range(____) for ____ in range(____)}

print(Q)