Eine Runde Backpropagation

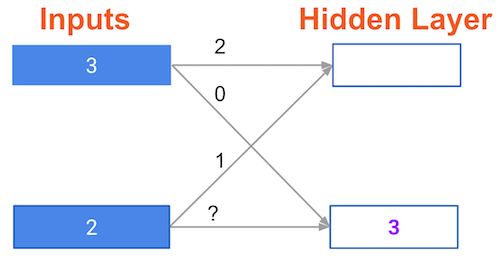

Im unten gezeigten Netzwerk haben wir Forward Propagation durchgeführt; die dabei berechneten Knotenwerte sind in Weiß dargestellt. Die Gewichte sind in Schwarz dargestellt. Die Schichten nach dem Fragezeichen zeigen die im Rahmen der Backpropagation berechneten Steigungen anstelle der Forward-Propagation-Werte. Diese Steigungswerte sind in Lila dargestellt.

Dieses Netzwerk verwendet wieder die ReLU-Aktivierungsfunktion. Daher ist die Steigung der Aktivierungsfunktion Eins für jeden Knoten, der einen positiven Eingabewert erhält. Nimm an, der betrachtete Knoten hatte einen positiven Wert (die Steigung der Aktivierungsfunktion ist also Eins).

Wie groß ist die Steigung, die benötigt wird, um das Gewicht mit dem Fragezeichen zu aktualisieren?

Diese Übung ist Teil des Kurses

Einführung in Deep Learning mit Python

Interaktive Übung

In dieser interaktiven Übung kannst du die Theorie in die Praxis umsetzen.

Übung starten

Übung starten