Forward Propagation in einem tieferen Netzwerk

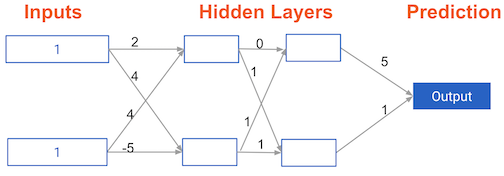

Dir liegt ein Modell vor mit zwei versteckten Schichten. Die Werte für einen Eingabedatenpunkt stehen in den Eingangsknoten. Die Gewichte sind an den Kanten/Linien angegeben. Welche Vorhersage würde dieses Modell für diesen Datenpunkt machen?

Nimm an, die Aktivierungsfunktion an jedem Knoten ist die Identitätsfunktion. Das heißt, die Ausgabe jedes Knotens entspricht seiner Eingabe. Daher ist der Wert des unteren Knotens in der ersten versteckten Schicht -1 und nicht 0, wie es bei Verwendung der ReLU-Aktivierungsfunktion der Fall wäre.

Diese Übung ist Teil des Kurses

Einführung in Deep Learning mit Python

Interaktive Übung

In dieser interaktiven Übung kannst du die Theorie in die Praxis umsetzen.

Übung starten

Übung starten