Expected SARSA'yı uygulamak

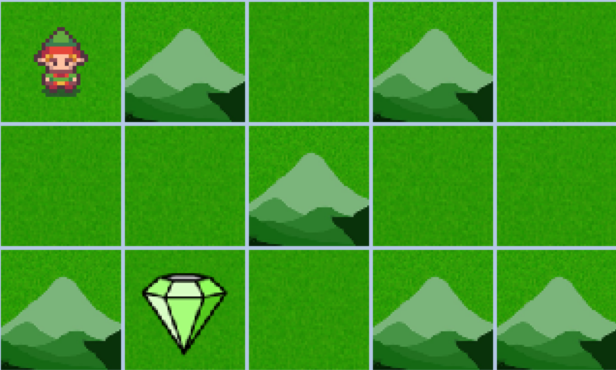

Şimdi Expected SARSA algoritmasını aşağıda gösterilen özel bir ortamda uygulayacaksın. Hedef, bir ajanın bir ızgarada gezinerek mümkün olan en hızlı şekilde hedefe ulaşmasıdır. Öncekiyle aynı kurallar geçerli: elmas noktasına ulaştığında +10 ödül, bir dağdan geçtiğinde -2 ve diğer her durum için -1 alır.

Ortam env olarak içe aktarıldı.

Bu egzersiz

Python ile Gymnasium'da Reinforcement Learning

kursunun bir parçasıdırEgzersiz talimatları

- Her durum-eylem çifti için Q-tablosu

Q'yu sıfırlarla başlat. - Q-tablosunu

update_q_table()fonksiyonu ile güncelle. - Öğrenilen Q-tablosundan politikayı bir sözlük (dictionary) olarak çıkar.

Uygulamalı interaktif egzersiz

Bu örnek kodu tamamlayarak bu egzersizi bitirin.

# Initialize the Q-table with random values

Q = ____

for i_episode in range(num_episodes):

state, info = env.reset()

done = False

while not done:

action = env.action_space.sample()

next_state, reward, done, truncated, info = env.step(action)

# Update the Q-table

____

state = next_state

# Derive policy from Q-table

policy = {state: ____ for state in range(____)}

render_policy(policy)