Cálculos de perda do Actor Critic

Como etapa final, antes que você possa treinar seu agente com A2C, escreva uma função calculate_losses() que retorne as perdas para ambas as redes.

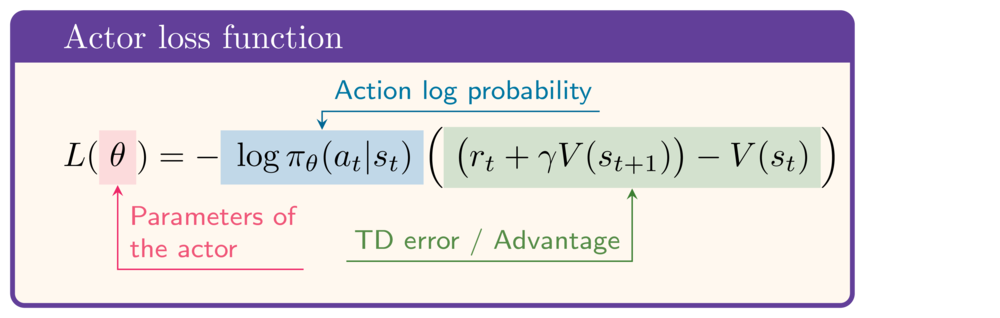

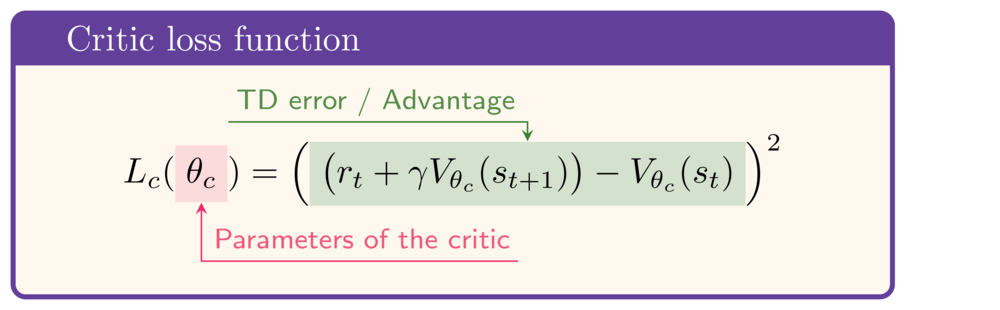

Para referência, estas são as expressões das funções de perda de ator e crítico, respectivamente:

Este exercício faz parte do curso

Aprendizado por reforço profundo em Python

Instruções do exercício

- Calcule a meta de TD.

- Calcule a perda da rede Actor.

- Calcule a perda da rede Critic.

Exercício interativo prático

Experimente este exercício completando este código de exemplo.

def calculate_losses(critic_network, action_log_prob,

reward, state, next_state, done):

value = critic_network(state)

next_value = critic_network(next_state)

# Calculate the TD target

td_target = (____ + gamma * ____ * (1-done))

td_error = td_target - value

# Calculate the actor loss

actor_loss = -____ * ____.detach()

# Calculate the critic loss

critic_loss = ____

return actor_loss, critic_loss

actor_loss, critic_loss = calculate_losses(

critic_network, action_log_prob,

reward, state, next_state, done

)

print(round(actor_loss.item(), 2), round(critic_loss.item(), 2))