Barebone DQN função de perda

Com a função select_action() pronta, falta apenas uma etapa final para que você possa treinar seu agente: agora você implementará calculate_loss().

O site calculate_loss() retorna a perda da rede para qualquer etapa do episódio.

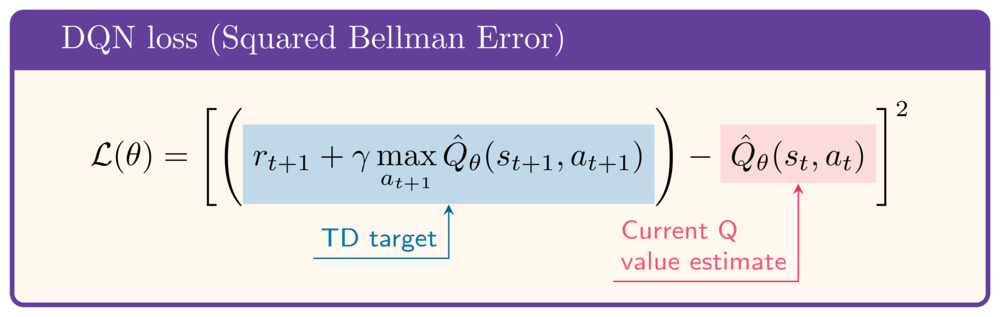

Para referência, a perda é dada por:

Os dados de exemplo a seguir foram carregados no exercício:

state = torch.rand(8)

next_state = torch.rand(8)

action = select_action(q_network, state)

reward = 1

gamma = .99

done = False

Este exercício faz parte do curso

Aprendizado por reforço profundo em Python

Instruções do exercício

- Obter o valor Q do estado atual.

- Obtenha o valor Q do próximo estado.

- Calcule o valor Q alvo, ou TD-target.

- Calcule a função de perda, ou seja, o erro de Bellman ao quadrado.

Exercício interativo prático

Experimente este exercício completando este código de exemplo.

def calculate_loss(q_network, state, action, next_state, reward, done):

q_values = q_network(state)

print(f'Q-values: {q_values}')

# Obtain the current state Q-value

current_state_q_value = q_values[____]

print(f'Current state Q-value: {current_state_q_value:.2f}')

# Obtain the next state Q-value

next_state_q_value = q_network(next_state).____

print(f'Next state Q-value: {next_state_q_value:.2f}')

# Calculate the target Q-value

target_q_value = ____ + gamma * ____ * (1-done)

print(f'Target Q-value: {target_q_value:.2f}')

# Obtain the loss

loss = nn.MSELoss()(____, ____)

print(f'Loss: {loss:.2f}')

return loss

calculate_loss(q_network, state, action, next_state, reward, done)