Aggregatie en filteren

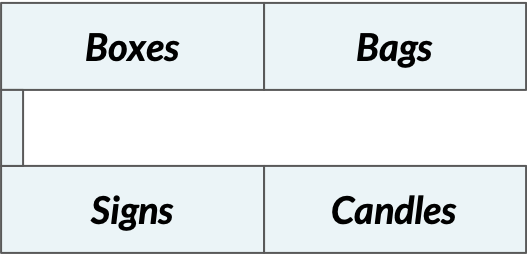

In de video hielpen we een manager van een cadeauwinkel met het indelen van de afdelingen in haar fysieke winkel op basis van associatieregels. Door de indeling van de winkel moesten we afdelingen groeperen in twee paren van producttypen. Na het toepassen van geavanceerde filtertechnieken stelden we de onderstaande plattegrond voor.

De winkelmanager vraagt je nu om een nieuw voorstel voor de plattegrond te maken, maar met een ander criterium: elk paar afdelingen moet één product met hoge support en één product met lage support bevatten. De gegevens, aggregated, zijn voor je geaggregeerd en one-hot gecodeerd. Daarnaast zijn apriori() en association_rules() geïmporteerd uit mlxtend.

Deze oefening maakt deel uit van de cursus

Market Basket Analysis in Python

Oefeninstructies

- Genereer de set frequente itemsets met een minimale supportdrempel van 0,0001.

- Identificeer alle regels met een minimale supportdrempel van 0,0001.

- Selecteer alle regels met een antecedent support groter dan 0,35.

- Selecteer alle regels met een maximale consequent support lager dan 0,35.

Praktische interactieve oefening

Probeer deze oefening eens door deze voorbeeldcode in te vullen.

# Apply the apriori algorithm with a minimum support of 0.0001

frequent_itemsets = apriori(aggregated, ____, use_colnames = True)

# Generate the initial set of rules using a minimum support of 0.0001

rules = association_rules(frequent_itemsets,

metric = "____", min_threshold = ____)

# Set minimum antecedent support to 0.35

rules = rules[____['antecedent support'] > ____]

# Set maximum consequent support to 0.35

rules = rules[____ < 0.35]

# Print the remaining rules

print(rules)