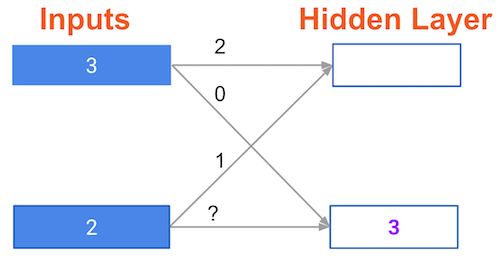

Satu putaran backpropagation

Pada jaringan di bawah ini, kita telah melakukan forward propagation, dan nilai node yang dihitung sebagai bagian dari forward propagation ditampilkan dengan warna putih. Bobot ditampilkan dengan warna hitam. Lapisan setelah tanda tanya menampilkan kemiringan (slope) yang dihitung sebagai bagian dari back-prop, bukan nilai forward-prop. Nilai kemiringan tersebut ditampilkan dengan warna ungu.

Jaringan ini kembali menggunakan fungsi aktivasi ReLU, sehingga kemiringan fungsi aktivasi adalah 1 untuk setiap node yang menerima nilai masukan positif. Asumsikan node yang sedang diperiksa memiliki nilai positif (jadi kemiringan fungsi aktivasinya adalah 1).

Berapa kemiringan yang diperlukan untuk memperbarui bobot dengan tanda tanya?

Latihan ini adalah bagian dari kursus

Pengantar Deep Learning dengan Python

Latihan interaktif praktis

Ubah teori menjadi tindakan dengan salah satu latihan interaktif kami.

Mulai berolahraga

Mulai berolahraga