Inpainting d’image

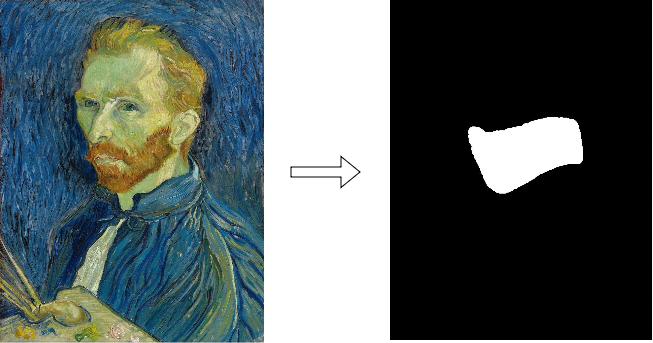

Ajoutons une touche originale à la génération d’images multi-modales en la combinant avec de l’inpainting d’image. Vous allez modifier l’autoportrait de Van Gogh pour lui ajouter une barbe noire en utilisant StableDiffusionControlNetInpaintPipeline et un masque d’image, déjà préparé pour vous (mask_image) :

Remarque : l’inférence avec les modèles de diffusion peut être longue, nous avons donc préchargé l’image générée pour vous. Exécuter des prompts différents ne générera pas de nouvelles images.

La version originale de l’image a été chargée sous init_image, ainsi qu’une image de contrôle (control_image) créée avec la fonction make_inpaint_condition() présentée dans la vidéo.

Cet exercice fait partie du cours

Modèles multimodaux avec Hugging Face

Instructions

- Exécutez le pipeline avec un prompt visant à générer une barbe noire, en spécifiant

num_inference_steps=40, et en passantinit_image,mask_imageetcontrol_image.

Exercice interactif pratique

Essayez cet exercice en complétant cet exemple de code.

# Run the pipeline requesting a black beard

output = pipe(

____,

num_inference_steps=____,

eta=1.0,

image=____,

mask_image=____,

control_image=____

)

plt.imshow(output.images[0])

plt.show()