De SHAP ontrafeld

Een van de redenen achter de magie van XAI (Explainable AI)-tools zoals SHAP is dat je niet alleen de algemene belangrijkheid van voorspellende features achter een model kunt tonen, maar ook de specifieke belangrijkheid en relatie tussen invoerkenmerken en één specifieke modeloutput of voorspelling.

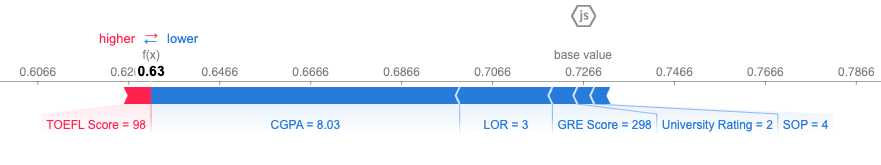

De onderstaande plot laat zien hoe belangrijk verschillende veelvoorkomende Amerikaanse testscores zijn bij het inschatten van de kans op toelating tot een universiteit, voor één specifieke aanmelding. De resulterende modelvoorspelling is een kwaliteitsniveau van 0,63 voor deze toelatingsbeslissing.

Hieronder staan vier uitspraken over het feature-belang en het modelgedrag in deze individuele voorspelling.

Eén van deze uitspraken is onjuist. Kun je die vinden?

Deze oefening maakt deel uit van de cursus

Artificial Intelligence begrijpen

Praktische interactieve oefening

Zet theorie om in actie met een van onze interactieve oefeningen.

Begin met trainen

Begin met trainen